AMD MI300X即将大量出货:有望抢下7%AI市场

2024-03-19

来源:快科技

虽然NVIDIA目前仍是AI芯片市场的霸主,不过年中开始,挑战者AMD的最强AI芯片MI300X也即将大批量出货,可能将会抢下部分NVIDIA的市场,并再次影响从晶圆代工到服务器的AI产品供应链。

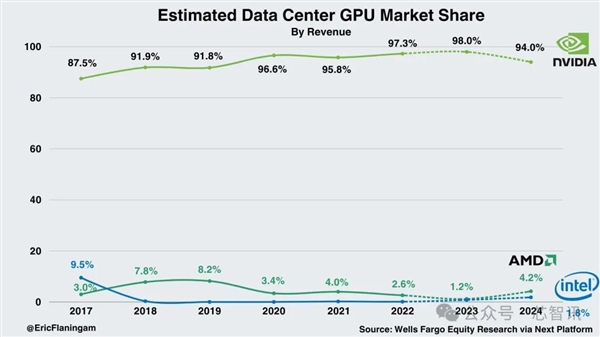

根据日本瑞穗证券报告,在目前的AI芯片市场,NVIDIA的市占率高达95%,“远比AMD和英特尔的份额相加还要高”。

NVIDIA在2023年第四季仅数据中心业务的营收就高达184亿美元,较前一年同期增加了409%。

但随着AMD的最强AI芯片MI300X的出货,或将抢下NVIDIA的部分市场份额。

据业内人士透露,AMD MI300X芯片目前已小量出货,微软等正在测试。这款芯片下半年预计会有大量出货,主要买家是微软等有大型数据中心的公司,“5或6月开始,就会有一批拉货潮”。

据悉,微软、Meta、甲骨文、OpenAI等大厂都会采购这款芯片,美超威、华硕、技嘉、鸿佰科技、英业达、云达等服务器厂也在设计解决方案。

在去年的第三财季会议上,AMD CEO苏姿丰表示,数据中心收入2024年可达20亿美元,这代表MI300会是AMD史上最快营收达10亿美元的产品。

AMD反击NVIDIA的武器,是利用更高容量的高带宽內存(HBM)和先进封装提高AI运算效率。

AI芯片挑战在于,要在內存和处理器间搬动大量数据,因此AMD采用台积电的先进封装技术,将原本放在芯片外的內存直接搬进芯片,让大量数据直接在芯片内就能从內存搬到处理器计算。

在此前的发布会上,AMD CEO苏姿丰就表示,只用一颗芯片,就能执行数据量高达40GB的AI模型,而这颗芯片最高可执行80GB 的AI模型。

根据官方公布的数据显示,MI300X的HBM容量高达192GB,比NVIDIAH100 SXM芯片的80GB高了一倍多,多项算力测试性能也高于NVIDIAH100 SXM芯片。

不过,随后NVIDIA也拿出数据来表示,辉达H100芯片性能比MI300X明显更快,并公布测试细节,让使用者自行比较两颗芯片性能。

双方之间竞争的火药味明显上升。

对于AMD来说,除了MI300X的产品优势之外,它还有着另一大优势,那就是客户不希望AI芯片市场被NVIDIA独占。

据业界人士观察,“AI芯片问题不是产能不够,是NVIDIA卖的很贵”。

微软等大客户不希望市场只有一家供应商很正常,但自研芯片又无法像专业的半导体公司,在性能上保持领先,自然希望有新的供应商出现,不仅性能能和NVIDIA匹敌,价格还更具优势。

根据富国银行此前的预测,AMD虽然在2023年的AI芯片的营收仅为4.61亿美元,但是2024年将有望增长到21亿美元,将有望拿到4.2%的市场份额。Intel也可能拿到将近2%的市场份额。

这将导致NVIDIA的市场份额可能将小幅下滑到94%。

不过,根据AMD CEO苏姿丰在1月30日的电话会议上公布的数据显示,AMD在2023年四季度的AI芯片营收已经超越此前预测的4亿美元,同时2024年AMD的AI芯片营收预计也将达到35亿美元,高于先前预测的20亿美元。

如果AMD的预测数据准确的话,那么其2024年在AI芯片市场的份额有望进一步提高到7%左右。

然而NVIDIA也不会坐等竞争对手壮大。

3月18日,NVIDIA即将召开GTC2024大会,届时将会正式发布全新的AI芯片H200,将会把HMB内存从上一代的80GB提升至141GB,并且采用的是速率更快的HBM3E规格。

此外,NVIDIA今年还将提出更强的B100芯片,其性能将会达到H200的两倍。AMD明年也会推出新一代的采用HBM3E内存的AI芯片MI350进行应对。

供应链方面,随着NVIDIA和AMD对于HBM容量及规格的需求提升,HBM的供应也将持续供不应求。目前两大HBM供应商——SK海力士和美光的今年的HBM产能都已经销售一空。

与此同时,台积电的先进封装产能也仍面临供应紧张的局面,因为不仅AI芯片需要先进封装产能,HBM芯片的制造也需要先进封装产能。

对此,台积电在2023年启动了其CoWoS先进封装产能大扩产计划。

近日业内传出,台积电本月对台系设备厂再度追单,交机时间预计将在今年第四季,因此,今年年底台积电CoWoS月产能将有机会比其原定的倍增目标的3.5万片进一步提高到4万片以上。

台积电更是和SK海力士结盟,大力布局HBM。

业界人士预测,接下来AI芯片会越来越多元,从高阶一路到中低阶,配合从模型训练到AI边缘计算需求。

比如,上个月美国人工智能初创公司Groq最新推出的面向云端大模型的推理芯片引发了业内的广泛关注,该芯片采用了全新的Tensor Streaming Architecture (TSA) 架构,以及拥有超高带宽的SRAM,从而使得其对于大模型的推理速度提高了10倍以上,甚至超越了NVIDIA的GPU。这也使得一些客户对于Groq的AI芯片产生的兴趣。

近日,新创AI芯片公司Cerebras Systems近日推出了其第三代的晶圆级AI芯片WSE-3,具有125 FP16 PetaFLOPS的峰值性能,相比上一代的WSE-2提升了1倍,将用于训练业内一些最大的人工智能模型。

与此同时,Cerebras还推出了基于WSE-3的CS-3超级计算机,可用于训练参数高达24万亿的人工智能模型,这比相比基于WSE-2和其他现代人工智能处理器的超级计算机有了重大飞跃。

另外,如果只是用来推理,X86和Arm处理器也有机会拿到一定的市场。