中文引用格式: 徐颖杰,张宇,黄启光,等. 适配语义对齐图像字幕方法[J]. 电子技术应用,2026,52(5):141-148.

英文引用格式: Xu Yingjie,Zhang Yu,Huang Qiguang,et al. Adaptive semantic alignment image captioning method[J]. Application of Electronic Technique,2026,52(5):141-148.

引言

随着多模态大语言模型[1-2]在跨模态理解和生成上取得令人瞩目的成功,以冻结的特征提取器、可训练特征对齐适配器、冻结的大语言模型组成的编码器-解码器架构正成为图像字幕领域的主流技术范式[3-4]。该范式的核心优势在于,它能够充分激发和利用预训练视觉模型与语言模型中蕴藏的海量知识资产,将其作为高质量、可复用的基础数据要素,从而避免从零开始训练的巨大成本。然而,该架构也面临一个关键挑战:如何高效、精准地实现视觉数据要素与文本数据要素之间的语义对齐,以保障视觉信息流能够无损、高效地流通至语言模型,并驱动其生成忠实于图像的描述。

为解决上述跨模态对齐的难题,先前的研究主要致力于设计更精巧的适配器来桥接视觉与语言模态。例如,BLIP-2[5]提出了一个预训练的图文转换器,作为连接冻结图像编码器与冻结LLM的桥梁;Flamingo[6]则通过在大语言模型的每一层插入门控注意力层,来实现深层次的跨模态交互;而LLava[7]采用了一种相对直接的方式,使用可学习的线性层或多层感知机来映射图像特征。这些方法的核心思路是构建一条从图像到文本的单向特征投射通道,力图将视觉数据要素转化为LLM能够理解的伪文本令牌。

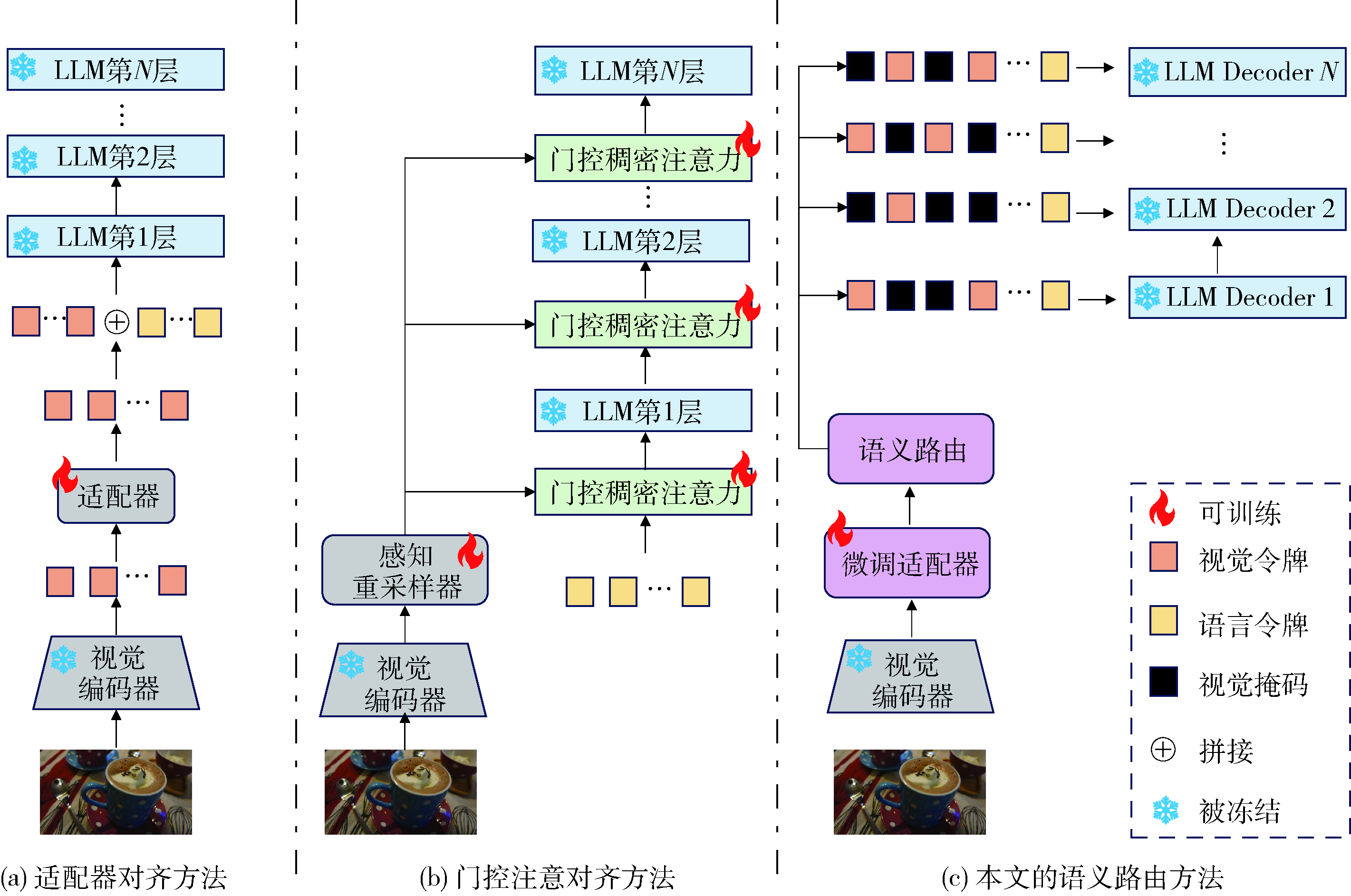

然而,近期研究揭示,这种单向、粗粒度的对齐策略存在固有缺陷[8]。图像令牌与文本令牌之间存在着巨大的模态鸿沟,简单的投影操作可能导致投射后的视觉令牌在语义尺度上与真实的文本令牌存在显著差异。当这些被投影的视觉数据要素注入LLM时,极易被模型误判为噪声令牌,从而引发错误的注意力分布,限制模型的对齐能力,甚至导致生成描述时的“幻觉”现象。这本质上反映了当前方法在促进多模态数据要素高效、保真地流通与融合方面存在瓶颈。如图1所示,尽管方法(a)和(b)在适配器设计上有所不同,但它们在大语言模型解码阶段仍依赖于单一的语义对齐尺度,导致噪声注入问题未能根本解决。

图1 跨尺度图文语义对齐示意图

针对这一核心问题,本文提出了一种名为适配语义对齐的图像字幕新方法。该方法旨在重塑视觉-语言模态间的数据流通路径,以实现更精细的语义对齐。具体而言,适配语义对齐方法首先通过一个微调的预训练适配器,对视觉特征进行初步压缩和语义提炼,完成数据要素的初步整合与降维。随后,本文创新性地引入了一个语义路由机制,该机制能够动态地评估每个视觉令牌的语义特性,并将其智能地转发至大语言模型的不同层级进行处理。这种设计使得视觉数据要素能够在多个尺度上与文本语义进行交互与对齐,从而有效缓解了因单一尺度对齐不匹配而导致的令牌失效问题,提升了跨模态数据流通的效率和鲁棒性。

在此基础上,本文的贡献可以概括为:

(1) 提出了一种新颖的适配语义对齐图像字幕方法,通过引入可微调的适配器,显著降低了需要处理的图像令牌数量,在减少模型可训练参数总量的同时,优化了数据要素的处理效率。

(2) 本文创新性的提出了语义路由,语义路由决定图像令牌在大语言模型的哪一层被处理,有效缓解图像令牌和文本令牌语义难以完全对齐导致图像令牌易失效问题。

(3) 在MSCOCO、Flickr30k、NoCaps等公共数据集上的实验结果表明,本文所提方法在仅需训练少量参数的情况下,各项性能指标均达到了目前的先进水平,验证了其在促进多模态数据要素价值释放方面的有效性。

本文详细内容请下载:

https://www.chinaaet.com/resource/share/2000007084

作者信息:

徐颖杰,张宇,黄启光,李斌

(数字大理建设运营有限公司,云南 大理 671000)