中文引用格式 : 黄家锋 , 吴丽君. 基于注意力信息关注与渐进梯度约束的二值化超分辨率网络 [J]. 网络安全与数据治理 , 2026 ,

45(2) : 28 - 33.

英文引用格式 : Huang Jiafeng, Wu Lijun. A binarized super-resolution network based on attention information focusing and progressive gradi- ent constraints [J]. Cyber Security and Data Governance, 2026 , 45(2) : 28 - 33.

引言

图像超分辨是计算机视觉和图像处理中的一个重 要任务 。它旨在从低分辨率图像中重建高分辨率图像。 基于 Transformer 的图像超分辨率网络因其全局的特征 提取能力能够重建恢复更真实的高分辨率图像而受到 广泛关注 。然而 , 其庞大的参数量导致推理过程需要 大量的内存使用和浮点运算 , 尤其是对于涉及高分辨率图像的超分辨率 (Super-Resolution, SR) 任务而言。 这些特点阻碍了其在计算存储资源有限的边缘设备上 部署 。因此 , 对基于 Transformer 的图像超分辨率网络 模型进行压缩 , 以加快推理速度并降低计算成本 , 同 时保持模型性能十分必要 。二值化神经网络 (Binary Neural Network, BNN) [1] 作为一种极致的模型压缩技 术 , 在模型轻量化方面潜力巨大 , 它能将网络权重和 激活值从全精度量化至单比特 , 并使用同或门运算和 位计数来替代复杂的浮点数乘和累加运算 , 从而提供数十倍的模型压缩率和显著的计算加速 , 为超分辨率 重建模型在资源受限边缘设备上的部署提供了极具潜 力的思路。

然而 , 现有二值化研究的应用场景多集中于图像 分类等上游视觉任务 , 直接将现有的二值化方法[2 -4] 应用于像素密集型超分任务会导致显著的性能下降。 例如 , Xia 等人[5] 提出 BBCU, 使用残差对齐方案来缓 解二值卷积输出数值范围不匹配问题 ; Li 等人[6] 通过 引入自适应非对称二值化方法来调整激活二值化的转 换点以减小量化误差 ; Xin 等人[7] 在 Rectified-BSR 模 型中使用多个不同阈值对激活值进行二值化并融合结 果 , 以减轻单一阈值带来的信息损失 ; Zhang 等人[8] 提出的 FRBC 方法不仅对权重进行二值化 , 还对一阶 二值化的残差也进行了二值化 , 二阶二值化的结果作 为辅助分支补偿主干二值化网络的量化误差 。上述二 值化超分研究工作主要聚焦于减小激活权重的量化损 失 , 却忽略了图像输入信息的限制 。相比较于对信息 损失具有更大容忍度的图像分类任务 , 像素敏感的超 分任务对输入信息分布要求更高。

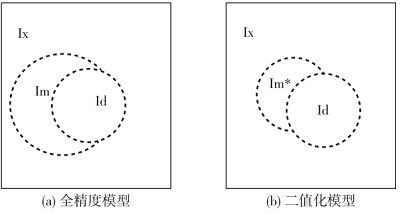

网络模型在训练时候的“ 输入信息 ”是指输入图 像中包含的全部信息 Ix , 包括目标信息 Id 和冗余信 息 。其中 , 目标信息即输入图像中与任务相关的关键 信息 , 其余的与任务无关的信息则为冗余信息 。一个 网络模型的训练目标是从输入中尽可能地提取相关信 息以满足特定任务的需要 。通常 , 一个全精度网络的 模型信息容量 Im 是可以充分表征这些相关信息的 , 且 又能容纳冗余信息 , 如图 1 (a) 所示 。神经网络训练 通过损失函数反向传播进行参数更新优化 , 是尽量让 模型信息容量 Im 包含目标信息 Id 的过程 。但是将网 络模型进行二值化过后 , 二值化模型信息容量 Im ∗ 就 变得很小 , 导致难以匹配目标信息 , 如图 1 (b) 所 示 。如何让模型快速地关注到与任务有关的相关信息 , 排除冗余信息对于像素敏感的超分任务显得至关重要。 为此 , 本文设计了一个注意力信息关注模块 , 通过将 注意力关注区域与输入信息进行掩码操作来滤除冗余 信息 , 生成注意力关注输入信息 , 引入先验知识来更 好地将 目 标 信 息 Id 匹 配 到 二 值 化 模 型 信 息 容 量 Im ∗ 上。

同时 , 由于注意力机制的特殊性 , 二值化注意力 层部分参数会出现梯度消失现象从而增加模型训练难 度 , 导致模型性能下降 , Bi-ViT[9] 引入了一个可学习 的缩放因子重新激活消失的梯度 , 但是也引入了额外 的浮点数计算 。为此 , 在不增加计算量的前提下 , 本文提出了一个简单有效的渐进梯度更新区间约束策略来扩大梯度更新区间,使得更多的参数参与更新优化。

图 1 模型信息容量示意图

综上所述 , 本文提出了基于注意力信息关注和渐 进梯度更新区间约束策略的二值化超分网络 BiSR-AG, 本文研究框架如下 :

(1) 基于全精度超分网络 SwinIR[10] 利用 XNOR- Net[11] 与 GSB[12] 二值化方法实现了一个二值基线网络。

(2) 在基线网络基础 , 针对二值化模型信息容量 较小难以匹配目标信息 , 设计了一个注意力信息关注 模块 IA, 获取模型关注区域的目标信息 , 抑制冗余特 征输入 , 更好匹配二值化模型。

(3) 为解决二值化注意力层部分参数会出现不更 新问题 , 提出了渐进梯度更新区间约束策略 GC。该策 略在训练初期设置较宽的直通估计器 (Straight-Through Estimator, STE) 梯度更新区间 , 确保注意力模块参数 获得充足的梯度更新空间 。随着训练轮次的增加 , 逐 步缩小梯度更新区间至标准范围 , 实现了平滑过渡 , 提升了注意力模块参数的优化效率 , 进而提高模型 精度。

本文详细内容请下载:

https://www.chinaaet.com/resource/share/2000006986

作者信息:

黄家锋 , 吴丽君

(福州大学 物理与信息工程学院 , 福建 福州 350108)