引言

光线在传播过程中会因大气中悬浮的微小颗粒和尘埃而发生多次散射,导致捕获的图像质量退化,出现模糊、对比度下降、色彩失真等问题[1]。在计算机视觉领域中,模型训练离不开清晰图像的支持,尤其是涉及语义分割、目标检测等相关任务,因此清晰图像的获取尤为重要。图像去雾旨在通过一系列处理,将模糊的雾霾图像还原成清晰的无雾图像,从而为相关任务提供技术支持。

图像去雾技术根据核心原理可分为三类:基于图像增强、基于物理模型及基于深度学习的方法[2]。早期图像去雾技术主要依赖于图像增强,通过调整图像的对比度或频域从而在视觉上改善清晰度,但未能从根本上消除雾霾。例如,Wu等人提出利用小波变换方法将图像分解为高频与低频分量[3],其中高频分量包含了边缘纹理等信息,通过处理高频系数增强图像细节,提升图像清晰度;Oakley等人提出直方图均衡化[4],通过调整图像的灰度直方图分布,增强图像对比度;Zhang等人基于Retinex理论[5],将去雾看作是解耦反射分量和光照分量的过程,通过分离光照干扰以恢复场景反射特性,从而改善图像质量。然而这类方法在处理非均匀雾霾或复杂场景时易出现色彩失真或过增强等问题。相比之下,基于物理模型的去雾方法,则是从大气光的成像原理出发,用大气散射模型描述雾霾图像的成因,如式(1)所示:

I(x)=J(x)t(x)+A(1-t(x))(1)

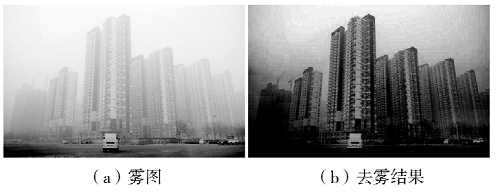

其中I表示雾霾图像,J表示无雾图像,t表示传输率,A表示大气光。由于t和A是未知变量,求解无雾图像J则成为一个病态问题,因此这类方法往往需要引入先验知识。经典的有He等人[6]提出的暗通道先验,指出无雾的清晰图像在RGB颜色空间上至少有一个通道上的像素值接近于0;Berman等人[7]提出“雾线”先验,指出RGB颜色空间中颜色相似的像素点会在有雾的情况由原先的簇状聚集转变成直线;Zhu等人[8]提出颜色衰减先验,指出像素的亮度和饱和度的差值和雾霾浓度呈正相关。引入这些先验知识,再结合大气散射模型,可求解出无雾图像J。但这些先验知识往往都是依赖于特定条件或场景,通过研究大量数据总结得出,一旦场景发生改变,先验可能会失效,进而影响最终的去雾效果。如He等人提出的暗通道先验,当图像中存在大面积的天空区域时,去雾后会产生严重的失真和Halo效应[9],如图1所示。随着技术的发展,研究者为了避免这一局限性,开始将深度学习应用于去雾任务,前期主要采用两段式,如Cai等人[10]提出的DehazeNet网络,先利用卷积计算透射率t,再结合物理模型求解出无雾图像。尽管级联估计能够逐步细化透射率与大气光参数,但该过程易发生参数误差叠加[11]。于是,研究者们进一步提出端到端的去雾方法,如Li等人[12]提出的AOD-Uet,直接将雾图作为输入,无雾图像作为输出,利用神经网络计算二者之间的映射关系,摆脱了物理模型的束缚。

图1暗通道去雾结果

目前,基于深度学习的端到端的去雾方法已经成为主流,通过数据驱动学习雾霾图像到清晰图像间的映射关系,其中基于编码器-解码器的网络结构,由于其可扩展性以及低复杂性,在去雾任务中受到广泛青睐。然而自然场景下的雾霾分布呈现显著的空间非均匀性,传统的编码器-解码器结构处理这种复杂场景时存在明显局限性:一是编码器在下采样过程中,虽然能够提取高层语义特征,但往往会丢失大量高频细节信息,尤其是在雾霾浓度较高的远景区域,图像的纹理和边缘细节容易被过度平滑;二是解码器在上采样阶段,难以精确重建与深度相关的雾霾分布特征,尤其是在景深变化剧烈的区域,容易出现不自然的过渡效果;三是网络信息传递单向,缺乏不同层级特征的动态交互,导致全局与局部特征协同不足。这些问题最终导致重建图像出现伪影、色彩失真以及对比度不足,从而削弱了去雾效果[13]。

为解决上述问题,本文提出了一种基于改进UNet的多尺度层级融合去雾网络(MHFEUN),主要贡献如下:

(1)针对编码器下采样过程中高频细节丢失问题,基于UNet改进结构,引入多尺度输入机制,通过不同尺度图像捕获层级特征,补充高频细节信息。

(2)针对解码器上采样过程中特征重建问题,提出了特征增强块(Feature Enhancement Blocks, FEB),通过融合高效通道注意力(Efficient Channel Attention, ECA)机制和像素注意力(Pixel Attention, PA)机制,精准聚焦景深剧烈变化区域的关键特征,避免空间信息丢失。

(3)针对全局与局部特征协同欠缺问题,提出了多尺度特征融合模块(Multiscale Feature Fusion Module, MSFM),以自适应特征交互机制替代传统线性连接,促进不同层级特征动态交互,实现全局与局部特征的充分协同。

本文详细内容请下载:

https://www.chinaaet.com/resource/share/2000006859

作者信息:

季云云1,熊亮2

(1.马鞍山学院大数据与人工智能学院,安徽马鞍山243100;

2.国轩高科动力能源有限公司,安徽合肥230041)