连获“双奖”,Xilinx AI 团队实力绽放国际视觉顶会

2021-11-24

作者:单羿,赛灵思AI 研发副总裁, 北京区总经理

来源:赛灵思

今年的夏天,对赛灵思中国 AI产品团队来说是一个不平凡的夏季: 在相继举行的一年一度2021 CVPR (IEEE Computer Vision and Pattern Recognition conference,即IEEE国际计算机视觉与模式识别会议),以及2021 ICCV ( IEEE International Conference on Computer Vision,即国际计算机视觉大会)上,我们的团队每个大会各斩获两份荣誉,“双奖”连连,激动人心。

CVPR 和ICCV 是全球排名前三的计算机视觉学术顶级会议中的两个(第三个是ECCV, 即欧洲计算机视觉会议 ),两大顶会相继授予的双重荣誉,无疑是对赛灵思 AI 产品团队在全球竞争领域技术实力和创新能力的高度认可和有力证明。

在人工智能领域, CVPR 位列谷歌 ( Google) 学术总榜第一名。2021 CVPR接受了赛灵思 AI 研发团队题目为《RankDetNet:探索目标检测中的排序约束(RankDetNet: Delving into Ranking Constraints for Object Detection )》的论文。与此同时,该团队也在CVPR 自动驾驶研讨会组织的 2021 Waymo 开放式数据集挑战赛中荣获三等奖。论文连续两年入选 CVPR和挑战赛全球季军的成绩,展示了赛灵思 AI 研发团队在理论与实践“双引擎”发展的道路上,正阔步前进。

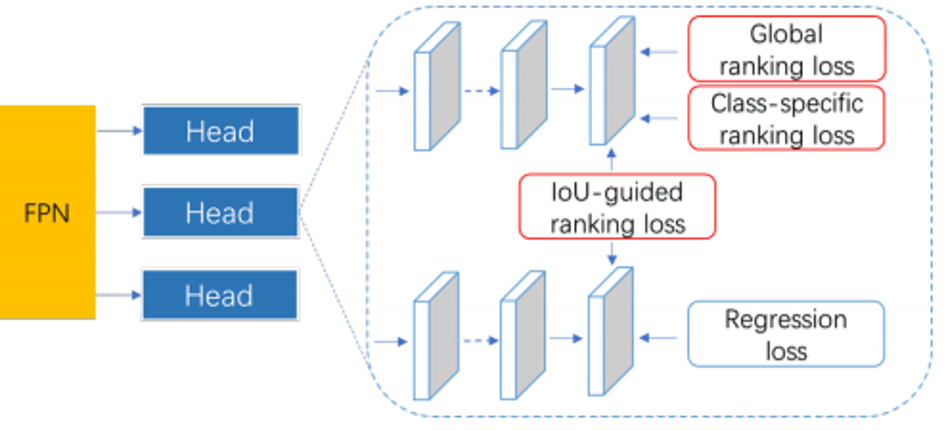

我们的论文采用一种新颖的方法 — 一种用于替代分类来学习候选框的排序和定位的排序优化方法。我们的工程师探索了各种排序约束条件,如全局排序、特定类别排序以及 IoU-guided 排序的损失等。传统的分类损失会忽略候选框之间的联系,通过配对排序优化的方法可以对候选框之间施加约束,这些约束有利于保留高质量的检测结果。该方法很容易实现,能够与主流检测框架兼容,而且不会增加推断计算。

我们的算法是用三种配对的排序损失替换常规的分类损失。最重要的是,RankDetNet 在 2D 及 3D 目标检测基线方法上实现了性能的一致提高。

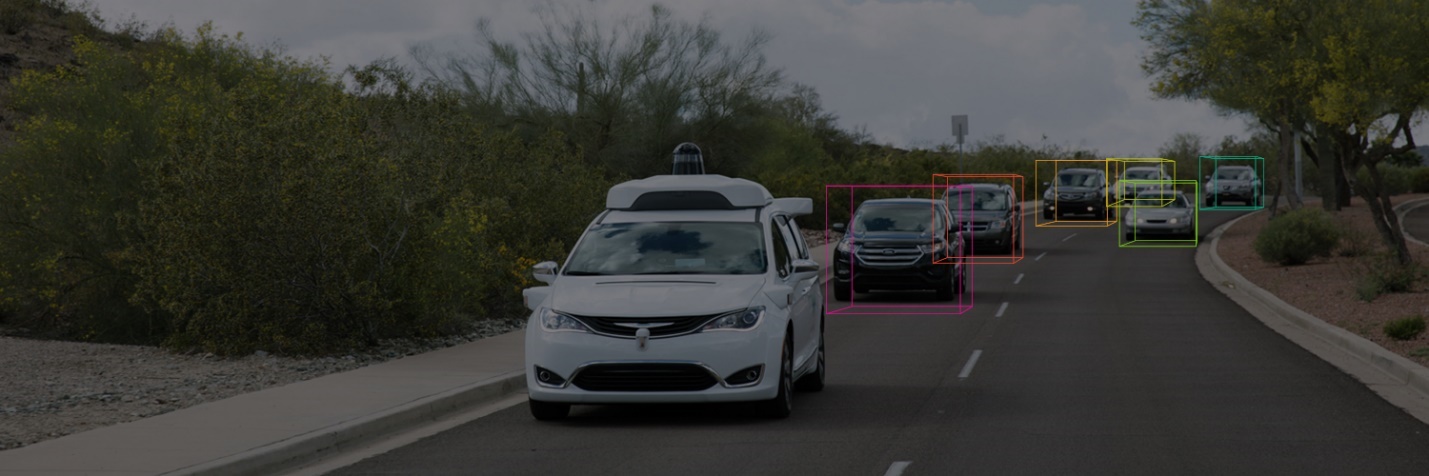

至于“Waymo 开放式数据集实时3D检测挑战赛”,参赛者的任务是通过一幅由3D LIDAR扫描生成的深度图,来为场景中的目标生成3D检测结果框。与此同时需要保证检测模型在英伟达Tesla V100 GPU上能达到每帧70毫秒的推理速度。

在此次挑战赛项目上,我们的团队展示了赛灵思在高级驾驶辅助系统 (ADAS) 应用上的算法开发实力。依靠多年来端侧部署的经验,我们使用PointPillars做为主干网络加快提取点云特征,同时采用Centerpoint的无锚框检测头提升精度。为了保证算法的实时性,引入了结构重新参数化技术、Quality Focal Loss等无推断时成本的方法来优化检测性能;同时还在基于网格特征的基础上引入了基于原始点云的特征,以改进检测目标的特征表达。使用这些方法,该团队最终在68.4毫秒每帧的检测速度下达到了70.46 mAPH/L2的准确度。这个成绩让该团队在3D点云检测挑战赛中荣获了第三名的成绩。

而在今年随后举行的ICCV 上,赛灵思 AI 研发团队又有两篇论文成功入选,再次获得“双赢”荣誉。

第一篇论文《通过Bin正则化改进低精度网络量化,(Improving Low-Precision Network Quantization via Bin Regularization)》,提出了一种新的权值正则化算法,旨在改进低比特网络的量化精度。该算法并没有优化weights的整体分布,而是分别优化每个量化Bin中的数据,使其尽可能接近目标量化值。这种Bin正则化 方法可以让weights的每个量化Bin的分布尽可能尖锐,理想情况下接近于Dirac delta分布。主流图像分类数据集 ImageNet上的实验表明,我们的方法对于不同网络结构(ResNet, MobileNetV2, MobileNetV3)、不同bit widths(4/3/2 bits)都获得了一致的量化精度提升。特别地,我们提出的Bin正则化方法使得 2 bits 的 MobileNetV2 和MobileNetV3-Small 在 ImageNet 上的top-1分别提高了 3.9% 和 4.9%。此外,该方法易于实现,而且很容易集成到现有的低比特优化算法上,从而进一步提高模型量化准确率。

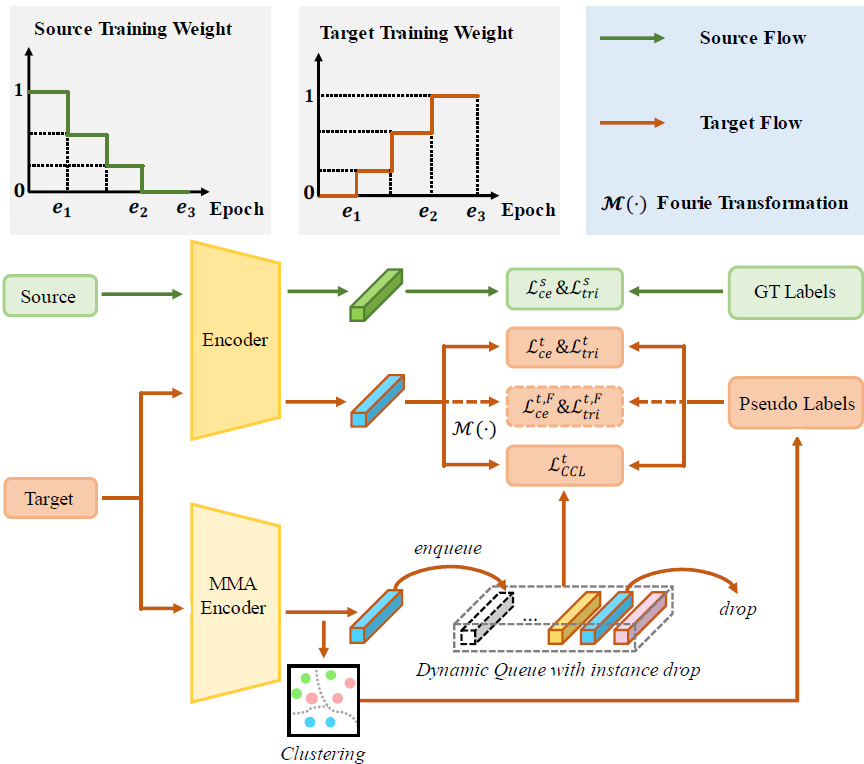

第二篇论文《无监督行人再识别的判别表示学习(Discriminant representation learning for unsupervised pedestrian re-identification)》,重点解决行人识别模型中典型的“两阶段”训练方法问题。行人再识别是智能监控和智慧城市中的重要任务,主要目的是在跨摄像头中识别同一个行人身份。有监督行人再识别通常需要耗时耗力的数据标注,很大程度上限制了模型的可扩展性。例如,当把一个在某个场景有监督预训练的模型直接应用在一个新场景时,识别效果往往大打折扣。因此,无监督域适应下的行人再识别应运而生,可以应对新场景没有数据标签的问题。

为此,我们提出了三种技术手段来解决这些问题。首先,我们通过特征学习和聚类精化的迭代优化提出了一种聚类对比学习算法(CCL,cluster-wise contrastive learning),以无监督的方式学习抗噪表示。其次,我们采用渐进式域适应(PDA,progressive domain adaptation) 算法来逐步缩小源数据和目标数据之间的域差距。第三,我们提出了傅里叶增强(FA,Fourier augmentation),通过在傅里叶空间中施加额外的约束来进一步最大化 re-ID 模型的类可分离性。实验证明,这种方法在多个主流 benchmark 上刷新无监督行人再识别的最好性能。例如,在 Market-to-Duke、Duke-to-Market、Market-to-MSMT和Duke-to-MSMT 四个 benchmark 上分别超越 MMT 方法 8.1%、 9.9%、11.4%和11.1% mAP。