大联大诠鼎集团推出基于Synaptics产品的机器视觉AI Hub方案

2025-06-29

来源:大联大控股

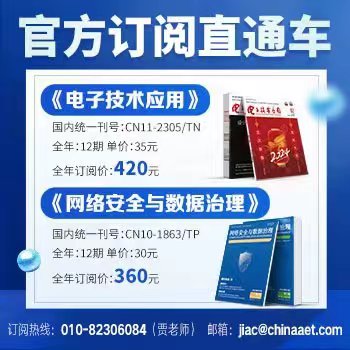

2025年6月17日,致力于亚太地区市场的国际领先半导体元器件分销商---大联大控股宣布,其旗下诠鼎推出基于新突思(Synaptics)SL1680嵌入式处理器的机器视觉AI Hub方案。

图示1-大联大诠鼎基于Synaptics产品的机器视觉AI Hub方案的展示板图

在传统安防系统中,许多摄像头并不具备AI功能。因此,在面对追踪、数据统计等复杂任务时,这些设备仍高度依赖人工操作,不仅耗费大量人力成本,且在效率与准确性上存在明显短板。在此背景下,大联大诠鼎基于Synaptics SL1680嵌入式处理器推出机器视觉AI Hub方案,依托丰富的外围接口和连接线,该方案可以从有线或无线网络中收集摄像头数据,并凭借强大的NPU运行多功能模型,实现物体识别、检测、统计乃至实时响应等功能。

图示2-大联大诠鼎基于Synaptics产品的机器视觉AI Hub方案的场景应用图

Synaptics旗下Astra™ SL系列嵌入式处理器是高度整合AI原生Linux和Android的系统级芯片(SoC),专为消费者、企业及工业物联网(IoT)工作负载硬件优化设计,其配备硬件加速器,可支持边缘推理、安全性需求、图形处理、视觉计算和音频应用。

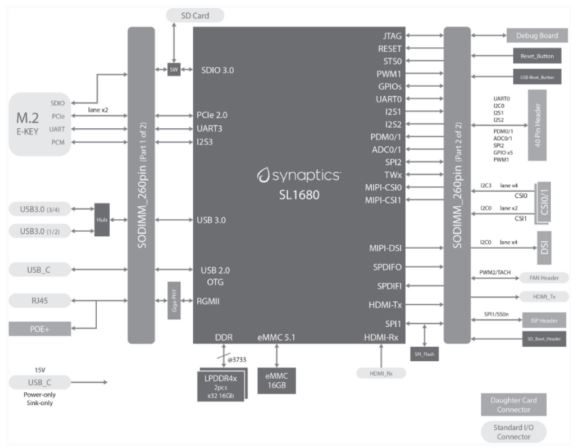

此次方案采用的SL1680是Astra™ SL系列嵌入式处理器中的一员,其整合高效能运算引擎,包括四核Arm® Cortex®-A73 64位CPU子系统、7.9+ TOPS的神经网络处理单元(NPU),以及专为高级图形和AI加速设计的高效、多功能GPU。此外,该产品还具备用于图像信号处理(ISP)、4K视频编解码以及音频加速的硬件模块,能够满足物联网细分市场的多模式应用需求。

图示3-大联大诠鼎基于Synaptics产品的机器视觉AI Hub方案的方块图

除此之外,Synaptics的官网中还提供SL1680软件开源代码,可以帮助用户更高效地开展相关设计工作,从而显著加快产品的开发进度。

核心技术优势:

强大的7.9TOPS NPU计算能力;

多模态、低成本的AIoT SoC解决方案;

4K级硬件编解码能力;

丰富的外围设备接口;

与Synaptics卓越的连接能力相匹配。

方案规格:

中央处理器:四核Arm® Cortex®-A73 64位处理器,带安全扩展。每个CPU的主频高达2.1GHz,提供高达40000DMIPS的性能;

内存接口:64/32位LPDDR4/LPDDR4x-3733 DRAM控制器,高达4GB内存空间,x1、x4或x8位eMMC 5.1控制器;

NPU:支持多个DNN框架,并通过SyNAP™工具包对TensorFlow™ Lite推理进行优化,高达7.9+ TOPS;

GPU:基于图形引擎(Imagination™ PowerVR™ Series9XE GE9920),分辨率高达3840×2160;

视频解码:支持AV1、H.265/264 MVC、VP8、VP9和MPEG-2。灵活支持PIP(2160p60/2160p60)和多视图(1×2160p60和3×1080p60);

视频编码:H.264、VP8多流编码,同时支持2160p60解码和1080p60编码;

其他:

本篇新闻主要来源自大大通:

基于Synaptics SL1680的机器视觉AI Hub方案

更多精彩内容欢迎点击==>>电子技术应用-AET<<