引言

近年来,大语言模型[1-2]的发展呈现出蓬勃的态势。虽然中文模型正在快速崛起,但在权威的全球语言模型基准测试平台Chatbot Arena[3]的排行中,显著体现出一个现象:当前位居前列的先进大语言模型[4-6]均为英文模型。其中,Meta的LLaMA3[7]模型在代码生成、逻辑推理、文本创作和摘要提炼等方面相较于同参数量级的竞争对手展现出了显著的性能提升。然而,值得注意的是,其应用场景主要聚焦于英文环境。尽管其训练数据涵盖了超过30种语言,但非英文的多语种数据在整体训练数据中的占比仅达到5%。英文大模型主要训练语料为英文,在英文场景下智能程度显著高于其他语种,直接将此类模型应用于特定语言场景将面临诸多挑战。

大模型英文能力显著高于其他语种的现象与预训练时学习语料的不平衡有直接关系,特别是在涉及各国各地区独特的知识能力和安全价值观时尤为显著。当非主要训练语言的用户与这些大模型进行交互时,往往会出现理解偏差甚至错误回答的情况。因此,大模型不仅需要深入掌握英文语境下的通用知识,具备基本的推理、计算、翻译、分类、生成等能力,而且必须能够因地制宜,根据用户所属特定文化下的知识能力和安全价值观进行精准交互,以确保信息传达的准确性和有效性。

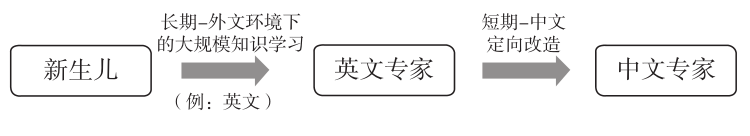

在大模型的实际应用中,如何维持其英文能力的卓越性,同时确保其在特定文化下的知识能力与安全价值观的对齐,是一项亟待解决的挑战。通过观察外国专家在华的成功适应案例(如图1所示),本文得以获得启示。以医学专家马海德为例,他作为瑞士日内瓦大学的医学博士,于1933年来华从事医学研究。他不仅积极投入诊疗与调研,而且迅速掌握了普通话及陕北方言,进而成功协助创建了中央皮肤性病研究所,并参与制定了针对性病和麻风病的防治计划,将其专业知识贡献于中国。马海德的事例表明,通过针对特定语言文化环境的能力提升和安全价值观调整,即便在文化背景与价值观存在差异的情况下,也能有效利用外国专家的专业知识。这一经验为大模型领域提供了借鉴:开发适应特定文化背景的能力增强与价值观再造方法,以高效地优化现有的英文大模型,使其更好地服务于全球不同文化背景下的用户。

图1外国专家(英文专家)中文本土化改造学习路线图

针对英文大模型在特定文化背景下的快速适配问题,本文提出一种基于特定文化下知识能力和安全价值观数据的指令微调流程与方法。该方法无需预训练,即可使模型在短期内实现对于特定国家与地区文化的快速适配。以中国文化为例,本文采用LLaMA38B作为待改造的英文大语言模型,深入探讨了指令微调策略在促进模型快速适配中文语境下基础能力与安全价值观的有效性。评估结果表明,经过知识能力与安全价值观改造后的大模型,不仅成功保留了其原先优越的专业知识,还显著增强了特定文化下的知识和能力,同时确保完全符合特定社会文化下的价值观和安全标准。

本文详细内容请下载:

https://www.chinaaet.com/resource/share/2000006856

作者信息:

张文静1,2,肖思琪1,2,雷雪娇1,2,王宁1,2,

张华正1,2,安美娟1,2,杨必琨1,2,

刘兆祥1,2,王恺1,2,廉士国1,2

(1.中国联通数据科学与人工智能研究院,北京100033;

2.联通数据智能有限公司,北京100033)