文献标识码: A

DOI:10.16157/j.issn.0258-7998.2016.09.002

中文引用格式: 刘亚伟,李小民,杨森. 基于CamShift融合局部特征匹配的无人机目标跟踪研究[J].电子技术应用,2016,42(9):6-9.

英文引用格式: Liu Yawei,Li Xiaomin,Yang Sen. Research of UAV target tracking based on CamShift fused local feature matching[J].Application of Electronic Technique,2016,42(9):6-9.

0 引言

随着科学技术的发展,无人机技术得到快速提高并广泛应用于军用和民用领域。目标跟踪作为无人机领域的一项重要课题受到了广泛关注。目前常见的目标跟踪算法有:均值漂移法、粒子滤波法、卡尔曼滤波法、特征点匹配法等。由于均值漂移(MeanShift)的目标跟踪算法[1]具有计算简单、实时性好、易于实现等特点,因此在现实生活中应用最为广泛。但是CamShift[2]最大的缺陷就是只采用颜色信息,造成跟踪特征单一,易受到颜色相似目标和背景的干扰,同时对较大的尺度变化和遮挡情况较敏感。特征匹配算法[3]由于其鲁棒性较强的原因近年来同样受到广泛关注,并广泛应用于医学、航天等领域。但是一个不足之处就是特征匹配算法随着图像复杂度的增加图像匹配的快速性随之降低。针对以上问题,本文提出了一种基于CamShift融合特征匹配的目标跟踪算法,提高了CamShift算法对相似颜色背景(或)目标的干扰,并增加了对尺度变化和遮挡的鲁棒性。

1 局部特征匹配算法的选取

目前常用的局部特征匹配算法有SIFT[4]算法,SURF[5]算法,ORB[6]算法,BRISK[7]算法和FREAK[8]算法。本文通过比较以上五种算法,来评价五种算法的综合性能。

1.1 特征检测性能测试

测试数据:待测试图像如图1所示。

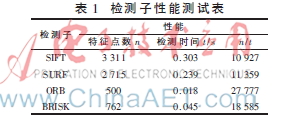

测试方法:在相同的硬件和软件环境下,运用不同的检测子,对相同图像进行特征点检测,分别计算出检测时间和检测到特征点的个数,比较结果见表1。

衡量标准:检测子检测得到的特征点数越多,所用时间越少,表示检测子性能越好。而考虑特征点数与检测时间的比值,可以衡量各检测子的综合性能。

1.2 描述子性能比较

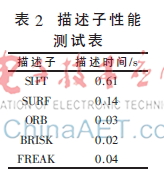

测试数据:同检测子性能评估测试数据一样,图像如图1所示。

测试方法:在相同的硬件和软件环境下,首先对同一图像进行特征检测,所使用的检测算子是SIFT检测子,再用不同的描述子进行特征描述,计算出各特征描述子所用的时间,比较结果见表2。

衡量标准:在测试数据和特征检测子一定的情况下,特征描述子的速度越快表示实时性越高,性能越好。

由表1和表2可得,BRISK算法无论是在特征点检测阶段和特征点描述阶段,都表现出了较好的性能,另外,由于BRISK采用二进制字符串进行特征描述,所以,在特征匹配阶段与SIFT和SURF采用的欧式距离匹配形式相比,汉明距离匹配速度更快。所以本文选用BRISK局部特征匹配算法对CamShift算法进行改进。

2 CamShift算法

MeanShift算法是一种基于核密度估计的非参数模式匹配算法。CamShift是MeanShift算法的应用推广。首先手动选取待跟踪目标区域,使用MeanShift颜色直方图信息作为模板,再提取下一帧图像的颜色直方图,进行直方图匹配,通过计算相似度获得相似度密度分布图,图中的极值位置即为目标的位置。

CamShift算法的跟踪流程如图2所示。

3 改进算法关键技术简介

针对CamShift算法易受相似颜色目标和背景的干扰和对尺度变化和遮挡敏感的问题,本文采用CamShift融合BRISK的方法进行目标跟踪。该算法在CamShift跟踪正常的情况下,BRISK算法不介入,一旦CamShift跟踪失败,即前后两帧目标区域颜色直方图相差较大,BRISK算法马上介入。在匹配过程中,采用RANSAC[9]算法来进行误匹配点剔除处理从而获得正确匹配点对。当匹配成功时,标出目标区域,这时再次启动CamShift跟踪算法,提取该区域颜色直方图并继续进行跟踪。

分别设置前后两帧的颜色直方图信息H(i-1)和H(i)利用Bhattacharyya距离[10]进行相似程度判断,Bhattacharyya越大,则越相似。若dBhttacharyya(Hi-1,Hi)≤0.6则说明CamShift跟踪失败,一旦跟踪失败,把前一帧图像目标区域作为模板,通过BRISK算法在后续视频帧中进行目标匹配操作,直到匹配成功,并找到目标区域。

3.1 特征点重心偏移

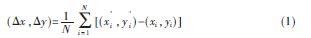

记BRISK特征匹配后,P={(xi,yi),Vi}分别表示目标区域的特征点集和CamShift跟踪区域的特征点集,其中i=1,2,…,N。CamShift跟踪区域与目标区域的重心平均偏移量可表示为:

3.2 BRISK跟踪结果

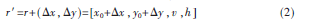

当前跟踪区域为r={x0,y0,v,h},(x0,y0)为跟踪矩形框的中心坐标,h和v分别表示矩形框的水平和垂直方向半径。用r′表示BRISK跟踪区域,则:

3.3 融合

融合BRISK和CamShift的跟踪区域用r″表示,则:

其中权系数 介于0~1之间。

介于0~1之间。

4 实验结果及分析

实验选用HERO运动相机拍摄视频,分别用CamShift和改进算法(基于CamShift融合BRISK的目标跟踪算法)进行对比测试。实验是在VS2010开发平台上,利用VC++语言和开源代码OpenCV联合编程实现。其中硬件系统:处理器为Inter(R)Core(TM) i3 CPU M390@2.67 GHz,内存为4.00 GB,硬盘为500 GB,操作系统为Windows 7。

4.1 目标受相似目标干扰下的目标跟踪效果

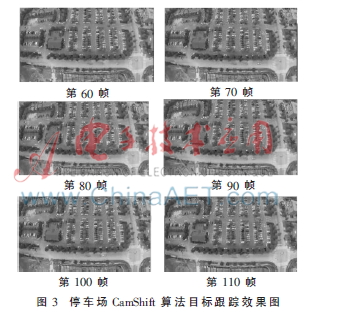

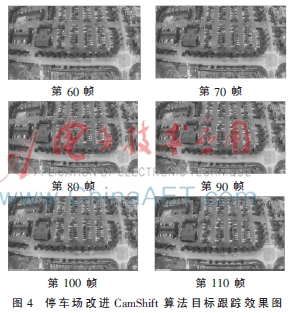

本实验采用停车场航拍视频进行测试,测试结果如图3和图4所示。

图3和图4分别为原始CamShift算法和本文改进CamShift算法(融合CamShift和特征匹配的目标跟踪算法)在航拍停车场视频中对车辆跟踪的效果图。原始CamShift算法在车辆经过与目标颜色相似的车辆时(如图3,第60帧—第110帧),算法将相似车辆误认为跟踪目标跟踪窗口出现了明显的扩散,跟踪效果明显变差。改进CamShift算法在经过颜色相似车辆时,跟踪窗口也出现了扩散,但是改进算法跟踪窗口的扩散较原始算法有较大改善,能够基本达到对目标车辆的准确跟踪。

本文用Bhattacharry系数(BH系数)作为目标跟踪准确度的衡量标准,目标模板与候选模板的相似度可用BH系数来表示,BH系数为0~1之间的一个数值,该数值越大,表示目标模板与候选模板的相似程度越高,即跟踪准确性越高。测试结果如图5所示。

图5所示,当目标接近颜色相似车辆时,CamShift算法跟踪框发生明显变化,导致BH系数具有较大幅度下降,当目标通过干扰区域时,跟踪框恢复正常,BH系数恢复正常。而本文改进跟踪算法对增强可跟踪算法对相似目标干扰的抗干扰性,当目标经过干扰目标,BH系数只具有小幅度变化。

4.2 目标遮挡情况下的目标跟踪

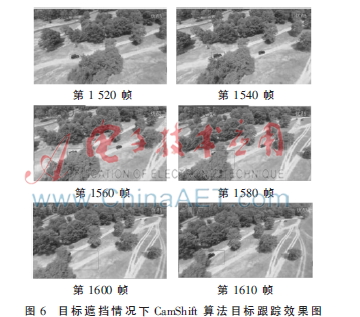

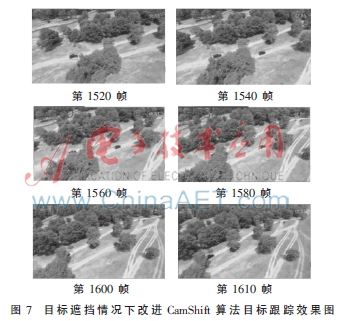

本实验采用车辆越野航拍视频进行测试,测试结果如图6和图7所示。

图6和图7是原始CamShift算法和本文改进算法对航拍越野车辆视频中车辆目标的跟踪效果图。当目标发生部分遮挡或全部遮挡时,对原始CamShift算法影响较大,当目标发生遮挡的情况下,跟踪效果明显下降,跟踪框明显扩散,甚至导致跟踪失败(如图6,第1 560帧~第1 600帧)。本文改进算法由于融合了CamShift和BRISK算法,通过颜色特征和目标局部特征共同定位增强了原始算法对目标遮挡的鲁棒性,跟踪效果有较大改善如图7所示。

本文采用有效帧率对目标被遮挡情况下算法跟踪效果进行测试,有效帧率是指视频跟踪过程中有效跟踪的帧数与总帧数的比值,用来衡量跟踪算法的有效性。判断某一帧是否为有效帧的方法可采用BH系数法,当BH系数小于某一阈值时,即认为该帧为跟踪无效帧,本实验取值为0.5。本实验从第1 450帧进行测试,到1 700帧共250帧,测试结果如表3所示。

由表3可知,改进算法相比于原始CamShift算法跟踪精度明显提高,有效帧率提高近27%。

5 结论

针对CamShift无人机目标跟踪算法对跟踪过程中相似目标或背景干扰和目标遮挡问题鲁棒性差的问题,提出了一种融合CamShift算法和BRISK算法的目标跟踪算法,并分别对CamShift算法和改进算法在相似目标干扰和遮挡情况下的跟踪效果进行测试。实验结果表明,改进算法显著增强了CamShift算法相似目标干扰和目标被遮挡条件下跟踪的鲁棒性,并提高了CamShift跟踪算法的跟踪准确性。

参考文献

[1] 杨辉,刘军,阮松.基于Mean Shift算法视频跟踪研究[J].计算机工程与设计,2013,34(6):2062-2066.

[2] 覃虎跃,支琤,徐奕.基于三维直方图的改进CamShift目标跟踪算法[J].现代电子技术,2014,37(2):29-33.

[3] 曹建,谢晓方,付霖宇,等.基于两步位操作匹配的实时目标识别跟踪算法[J].弹箭与制导学报,2013,33(2):125-128.

[4] KE Y,SUKTHANKAR R.PCA-SIFT:a more distinctiverepresentation for local image descriptors[C].Proceedings ofthe IEEE Computer Society Conference on Computer Visionand Pattern Recognition.Los Alamitos:IEEE Computer Soci-ety Press,2004:506-513.

[5] BAY H,ESS A,TUYTELAARS T,et al.Speeded up robustfeatures(SURF)[J].Computer Vision and Image Understand-ing,2008,110(3):346-359.

[6] RUBLEE E,RABAUD V,KONOLIGENCE K et al.ORB:Asufficient alternative to SIFT or SURF[C].2011 InternationalConference on Computer Vision,Barcelina,Spain,2011:2564-2570.

[7] LEUTENEGGER S,CHLI M,SIEGWART R.BRISK:Binaryrobust invariant scalable keypoints[C].Proceedings of theIEEE International Conference on Computer Vision(ICCV),2011.

[8] Alahi A,Ortiz R,Vandergheynst P.FREAK:Fast RetinaKeypoint[C].IEEE Conference on Computer Vision andPattern Recognition(CVPR),2012.

[9] 周凯汀,郑力新.基于改进ORB特征的多姿态人脸识别[J].计算机辅助设计与图形学学报,2015(2):287-290.

[10] 刘玉.基于特征点的运动目标跟踪技术研究[D].南京:南京航空航天大学,2011:38-46.